¿Qué es Shadow AI y por qué es un problema?

El término Shadow AI se refiere al uso de herramientas de inteligencia artificial (IA) en entornos laborales sin la autorización o supervisión del departamento de TI o de la dirección. Esto puede incluir el uso de aplicaciones como ChatGPT, Copilot o Gemini por empleados que buscan agilizar sus tareas sin entender los riesgos involucrados.

El Reglamento (UE) 2024/1689 establece varias obligaciones para los proveedores y usuarios de sistemas de IA (Art. 6), señalando la importancia de la transparencia y la gestión de riesgos. Cuando los empleados utilizan IA sin supervisión, se incrementan los riesgos sistémicos y de seguridad.

¿Cuáles son los riesgos asociados con Shadow AI?

Los riesgos del uso no autorizado de IA pueden ser significativos:

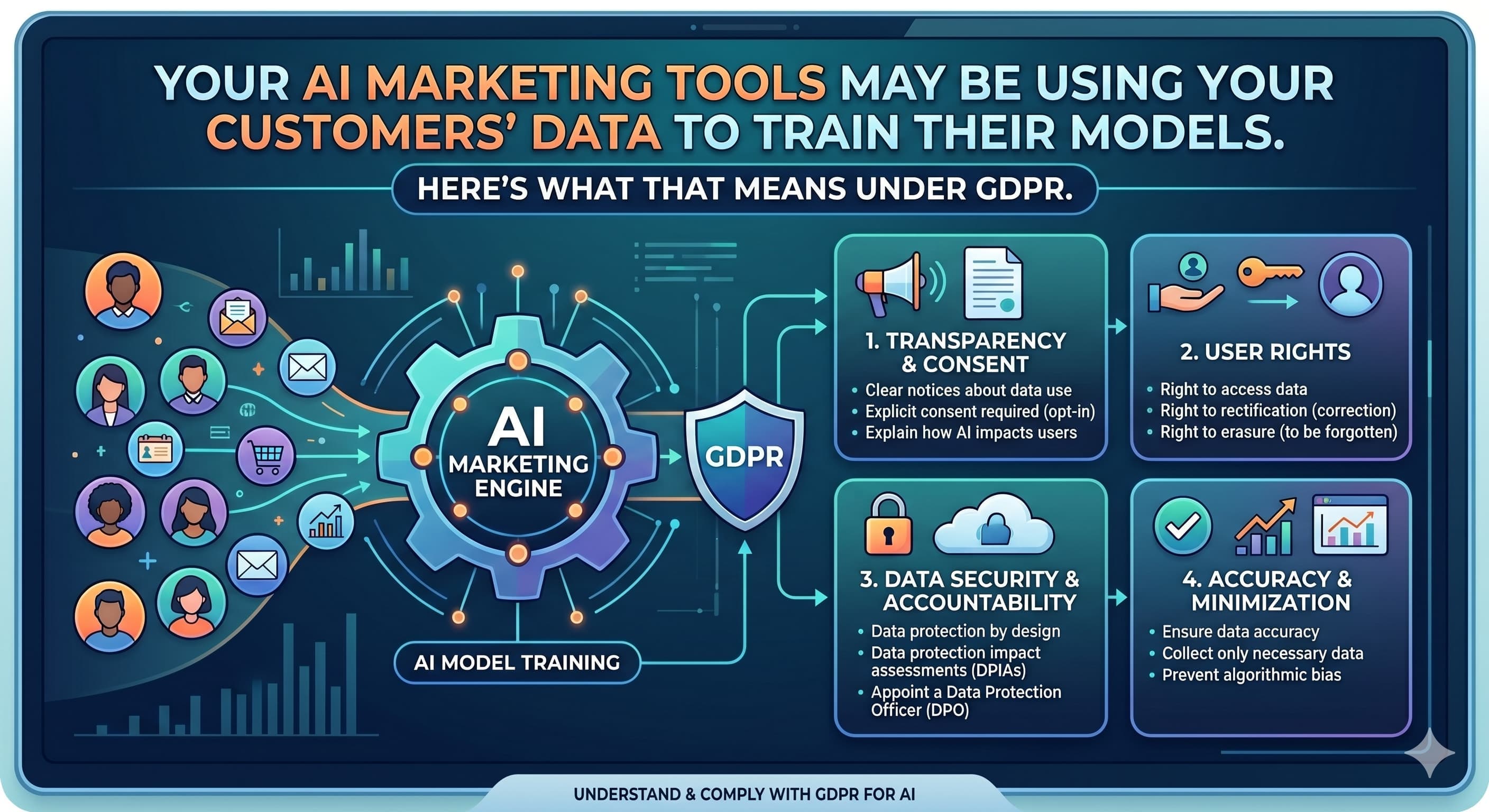

- Fuga de datos: Los empleados pueden introducir información sensible en aplicaciones externas, exponiendo a la empresa a brechas de seguridad.

- Desinformación: La IA generativa puede producir contenido erróneo, lo que podría perjudicar la reputación de la empresa.

- Falta de supervisión: Sin un control adecuado, es difícil evaluar la calidad y seguridad de los resultados generados por la IA.

¿Quién está afectado por el uso de Shadow AI?

El uso de Shadow AI afecta a múltiples partes interesadas dentro de una empresa:

- Empleados: Pueden enfrentar problemas de rendimiento o de seguridad al usar herramientas no autorizadas.

- Directivos: Deben gestionar los riesgos asociados y garantizar la protección de los datos.

- Clientes: Pueden verse afectados si la calidad de los servicios se ve comprometida por el uso inapropiado de IA.

¿Cuándo se aplica la regulación sobre el uso de IA en empresas?

La regulación sobre el uso de IA en empresas, según el Reglamento (UE) 2024/1689, se aplicará a partir de agosto de 2026. Esto significa que las empresas deben prepararse para establecer procedimientos que incluyan la documentación del uso de IA y la gestión de riesgos asociados, tal como se detalla en el Art. 9 sobre la gestión de riesgos.

¿Cómo documentar el uso de IA en la empresa?

Documentar el uso de IA es fundamental para mitigar los riesgos. Aquí hay algunos pasos clave:

- Identificación de herramientas de IA: Hacer un inventario de todas las herramientas de IA utilizadas en la empresa, incluso aquellas que no están autorizadas.

- Evaluación de riesgos: Utilizar un enfoque sistemático para evaluar los riesgos asociados con cada herramienta de IA, como se menciona en el Art. 6 del reglamento.

- Formación y concienciación: Implementar programas de formación para empleados sobre el uso seguro y responsable de IA. AICONTEXT ofrece formación específica sobre el Reglamento de la IA que puede ser útil.

- Políticas de uso: Establecer políticas claras sobre el uso de IA en la empresa, indicando qué herramientas están permitidas y cuáles no.

- Revisión continua: Realizar auditorías periódicas del uso de IA, asegurando que la documentación esté actualizada y cumpla con las normativas.

¿Cómo puede AICONTEXT ayudar con la autoevaluación y documentación?

AICONTEXT se posiciona como una plataforma esencial para la autoevaluación y documentación del uso de IA en el contexto del Reglamento (UE) 2024/1689. Proporcionamos herramientas y recursos que facilitan la gestión de riesgos y la documentación necesaria para cumplir con las exigencias regulatorias. Puedes comenzar con una evaluación rápida GPAI para identificar áreas de mejora y preparar a tu empresa para el futuro.

La gestión efectiva del uso de IA en las empresas no solo ayuda a mitigar riesgos, sino que también contribuye a un entorno laboral más seguro y eficiente. Prepárate adecuadamente y utiliza las herramientas disponibles para garantizar que tu empresa esté lista para las exigencias del futuro.

IAContenido generado con IA · Aideal Developers S.L.U. · No constituye asesoramiento legal.

¿Tu empresa usa IA?

Documenta tu uso de IA con un AI Context Brief alineado al EU AI Act.